朋友们大家好,笔者,5年个人站长,在创业路上,我会在下面一篇5000字的长文中告诉大家,获取知乎流量的正确姿势,思路+实际操作,整合知行合一,资讯纯粹实用,细节丰富,敬请欣赏

根据我本地数据的不完全统计(知乎百度排名前3的关键词)

百度PC端关键词总流量为:12743万

知乎实际获得的总流量为:12743万×0.15(平均点击率)=1911万

这还只是看PC端,一个2000W以上的流量机会就在眼前

一切依靠互联网赚钱的前提都是先获得流量,现在流量比黄金还值钱

真实的情况是我身边已经有5个以上的朋友了。 这六个月里,我靠着这个机会获得了6W到25W不等的收入。

而我们只需要一双勤劳的双手和清醒的头脑

所以

为什么会有这个流量机会?

流量机会到底指的是什么?

我们如何从中获取流量?

接下来就让我为大家打开这个流程的大门

阅读指导:与市面上各种“酷文”不同,本文遵循我的实际思维,用叙事的方式讲述如何“从0到1”。 朋友们在读书的时候需要思考。 建议取出一整段。 阅读时间(10-20分钟)

1、资本的博弈

《江湖》中流传着这样一段话,大致内容是:

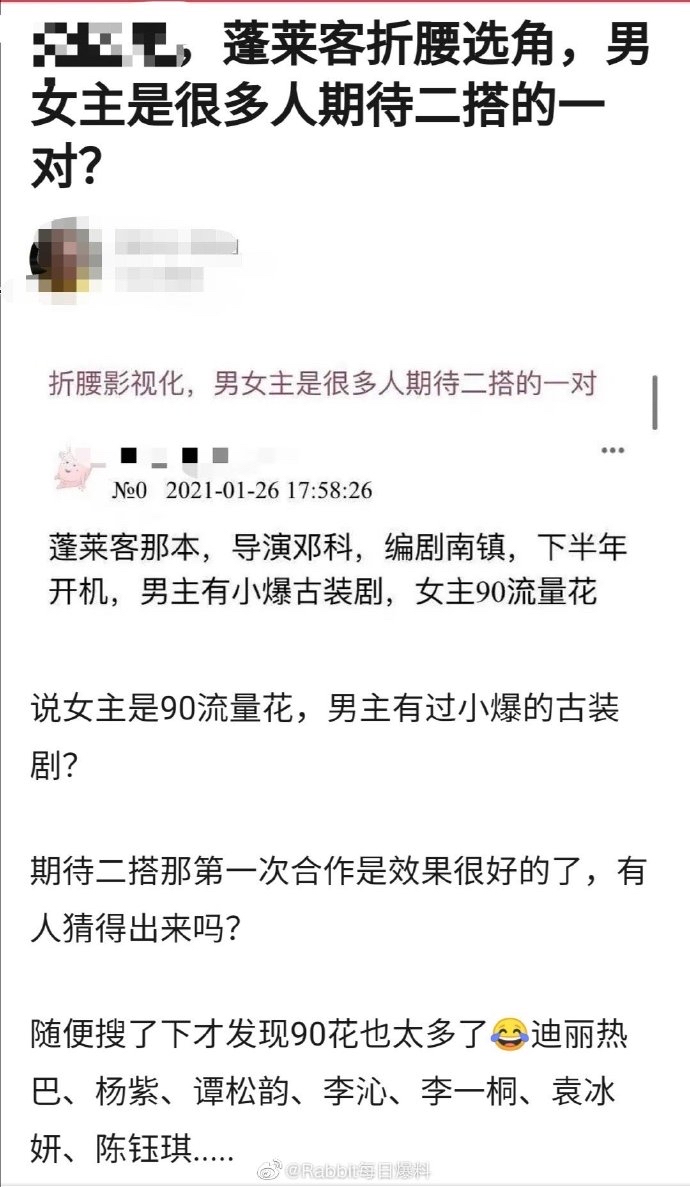

站长收割机、流量切割机 百度老爹于2019年8月紧随投资知乎,快手领投。 随后,百度对知乎进行了提权,流量表现持续上升。

当时看到这段话的时候,我对收到的信息量打了个问号,为什么呢?

熟悉传播学的朋友应该知道一个基本原理:

对于任何事情,我们应该尽量注重事实判断,而不是价值判断

因为事实判断是结论性的,能够达成共识; 而价值判断取决于观点和立场,并且可以有多种解释

这里的投资事件是事实描述,后续影响是价值描述

然而这样简单的事实描述网上却有N个版本,有的说时间点错误,有的说投资人错误

经过核实,你还会发现百度也投资了快手。 也许这是另一个机会?

有时想法只是源于事实

那么从价值判断来看,流量真的有增长吗? 真的能提升实力吗?

直接上数据验证(这里是爱占从投资时间点2019.8开始的半年数据,稍有误差问题不大):

字量数据

![图片[1]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_0.jpg)

![图片[2]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_1.jpg)

![图片[3]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_2.jpg)

从字数数据中我们可以观察到以下两点:

2019年11月中旬以来,流量大幅增长,字量从30W增长到270W,近10倍!

2020年7月开始流量增速放缓,但仍保持增长趋势

那么,这个流量是如何增长的呢?

记录数据

![图片[4]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_3.jpg)

![图片[5]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_4.jpg)

![图片[6]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_5.jpg)

![图片[7]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_6.jpg)

通过收集数据,我们可以观察到以下两点:

虽然数据口径不同,但在流量快速增长时期,收录量并未出现增长趋势。 也就是说,原来收录页面在对应搜索词下的排名有所提升,威力提升是实锤。

![图片[8]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_7.jpg)

当收录页面无法覆盖更多搜索词时,百度对知乎的定向流量就会达到临界值,打嗝~

上述分析很容易产生一种“无稽之谈的感觉”,因为分析结果与第一次接收到的信息基本相同,而我们的大脑无法处理相同的信息。

这正是“归纳”和“演绎”两种思维方式的区别

在未经验证的情况下,归纳思维隐含地假设百度的权力升级是真实的,导致后续的所有行动都基于一个假设。

演绎思维的每一步都完全建立在条件“真”的前提下。 想一想,如果分析结果相反会怎样?

在这个信息爆炸的时代,我们确实需要过滤信息的能力。 保持独立思考尤为重要,但独立思考并不意味着对所有事情都提出不同的意见。

有效的思维必须建立在足够的知识积累的基础上,否则就是盲目的思维

如果你在一个不熟悉的领域,向同行学习仍然是一个不错的选择

所以虽然流量增长放缓,但知乎并没有“吞噬”如此巨大的流量。 利用这个红利期获取流量、赚钱的机会还是肯定有的。

我们继续吧!

2.搜索引擎优化?

包容性? 排行? 权利改善? 如果您有疑问,那么您可能对SEO领域了解不多。 这是一个简短的描述

SEO是通过了解搜索引擎(以下简称SE)的规则来调整网站,以提高其在目标搜索引擎上的排名,达到获取流量的目的。

包含:SE爬虫系统爬取网页后,缓存在服务器上。

权重:SE对网站的综合评分,排名的主要依据

排名:页面缓存在搜索结果中的排名位置。

以上三点都是动态变化的

那么,搜索流量是如何产生的呢?

首先,用户输入搜索词(query)并向SE发起搜索请求。 SE通过算法对缓存的页面进行排序,然后返回给前端(浏览器)。 用户观察搜索结果并根据自己的喜好从搜索结果中点击。 页

一个页面想要有流量,首先要被收录(被SE缓存),然后要排名靠前(top10),然后要被搜索(搜索量),最后要被浏览并让人想要单击(标题+描述)

在点击过程中,知乎有着重要的先天优势。 经过多年“知识型”平台的定位和发展,用户对知乎品牌建立了天然的信任感。 这可能导致即使没有排在前3名,仍然可以获得超过同市场的点击率

这次两剑相锋,百度为知乎提供定向流量,知乎则提升流量效率。 很美丽。

3.蓝海问题+蓝海流量

那么我们的机会在哪里呢?

红红最近缺钱,就在百度上搜索“如何快速赚钱”(真实数据,只是举例),发现知乎上的某个页面排名第一

![图片[9]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_8.jpg)

然后他用颤抖的手点击进入。 看着空荡荡的书页,他的脸色微微一变。

![图片[10]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_9.jpg)

真是个蠢才! 就是这个!

五年的网赚经历让我拥有敏锐的嗅觉。 这是一个机会。

![图片[11]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_10.jpg)

于是我就得到了百万级关键词+知乎数据。 经过筛选和分析,我发现相当多的问题页面虽然有搜索流量,但都存在以下情况:

答复未解决的搜索请求

答案质量低

答案很少

前 N 个答案,点赞数很少

那么我们是否可以找到这类问题,自己写出答案,然后排名靠前,将流量引流到自己的运营商(微信/公众号等)上呢?

答案是肯定的!

综上所述,搜索流量和竞争低的问题统称为“蓝海问题”,而从这些问题中收集流量统称为“蓝海流量”

这里有一个小炸弹,朋友们可以先体验一下~(SE排名是动态的,你的实际搜索可能会略有不同,考虑到开放性,我选择了一个例子)

![图片[12]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_11.jpg)

![图片[13]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_12.jpg)

繁荣! 没错,就是同性恋。 同样的问题在 PC 端和移动端均排名第二。 移动端月均搜索量为44.7W,PC端月均搜索量为9.5W。 总共加起来是50W。 第二名的点击率在20%左右。 ,也就是说这个问题每个月有10W的SEO流量。 答案是什么?

![图片[14]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_13.jpg)

第一名只有58个赞。 还有机会再升高吗? 是的! 有办法将其货币化吗?

4.突破认知限制

有些朋友到了这里可能就坐不住了,开始思考自己的行业应该如何运作。

但是,如果你的行业没有蓝海流量怎么办? 为什么一定要在自己熟悉的领域做呢?

交通专家的思维一直是大局思维,即站在全局的角度思考问题。

这次,我们要分析一下知乎整体搜索流量的分布情况。 哪里有蓝海流量,我们就去哪里,而不仅仅局限于某个问题或行业。

就连知乎好物也可以完全基于蓝海流量的思维。

永远记住,我们只有一个目的,那就是赚钱

同时,这也是我写公众号【TACE】(Traffic ACE,流量专家)的主要想法,不过后来我去做了项目,很少发表文章了,咳……

我之前讲了很多内容,但那是因为我想在“道”的层面上讲清楚,即我为什么要做我所做的事情; 而“法律”已经死了。 如果规则发生变化,该方法将立即失效。

例如:特斯拉诞生时,电池成本比当时市场低10倍。 CEO马斯克为何能做到?

那是因为他的道是“物理思维”,将事物分解成最小的单位来寻找解决方案(TED演讲)

然而,80%的人更喜欢直接获取方法,为什么呢?

爸爸说,他听爷爷说,几十万年前,当人类还处于狩猎阶段时,为了生存,大脑就诞生了。

大脑的进化需要数百万年的时间,而人类的诞生也只有20万年左右。 也就是说,我们还在用“老脑子”

“老大脑”的显着特征之一就是最小力原则。 人类天生就有消耗较少脑力的行为。 也就是说,他们在可以动脑的时候却不会动脑。 学习原理需要较高程度的脑力。

包括我,每当懒得动脑子的时候,我就嘲笑自己是个原始人,咳咳……

那么下面,就让我们一步步进入“战场”

5、打造百万级词汇库

词库是用户搜索词和词属性的集合

我们尽量从N个渠道收集关键词,因为每个渠道或第三方平台都有其局限性。

在流量专家眼里,词库里存在的不是一个又一个的关键词,而是一个又一个的人民币。

从搜索流量的角度来看,大多数情况下,增加词就等于增加流量。

![图片[15]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_14.jpg)

如果你能找到别人找不到的词,你就能获得别人得不到的流量,从而赚到别人赚不到的钱。

关于数据存储格式,我个人建议直接使用csv格式,存储在本地文件中,并以逗号作为分隔符。 与mysql数据库相比,使用Bash shell进行查询分析并不是太方便。

获取单词的渠道:

5118,爱心站,站长之家。

下面我以5118为例

5.1 母词的习得

1)5118

分别下载百度PC端关键词和移动端关键词并分别处理。

![图片[16]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_15.jpg)

没有会员的朋友可以自行淘宝。 建议有企业版的朋友全额导出。

接下来,我们将开始涉及一些编程知识:

Bash shell (Linux) + Python

因为常规的工具已经不能满足这种数据计算的需要,所以我们不得不借助编程这种“神秘”的力量。

都是我自己开发的,文中直接给出了一些简单的Bash shell命令行。

但我相信仅这一点就会让80%的人放弃。 但包括我在内,谁没有一步步走过来呢?

编程真的没那么难,相信我! 如果可以的话,告诉自己去做那20%

另外,请记住,我们并不是想成为一名专业程序员,只要编程能力能够满足我们当前的需求即可。

2)初步处理

转码(GBK > UTF-8),因为5118给出的数据编码是GBK,而Linux需要UTF-8

只输出关键词,其他数据没有使用,因为第三方数据的准确性实在是差强人意。 像5118这样量级的日更新量至少是1亿,成本就在这里。

获得前100名第一是因为数据准确度较低。 稍后我们必须自己验证数据。 其次,正如之前提到的,动态排名&百度算力升级,从获取数据到验证数据之间存在一个时间差。 在时间差上,排名可能已经发生了。 种类。

bash外壳:

cat 输入文件名 | iconv -c -f GB18030 -t utf-8| grep -Ev "全域百度PC关键词排名榜|百度指数|超越100" | awk -F, '{print $1}' > 输出文件名

3)关键词清理

特殊符号

[\s+\.\!\?\/_,$%^*()+\"\']+|[+——!,::.√?,~@# ¥%……&*()""《》~]

很容易忽略一个步骤。 很多人自然信任不同渠道(包括百度)产生的关键词数据,但“流量大师”和“流量大师”的搜索量数据却相差甚远。

网址

www|com|cn|cc|top|net|org|net|cn|rog|cn|tv|info|wang|biz|club|top|vip

年份替换,例如2010替换为2020

中文长度>=2(可选)

4)删除敏感词

你知道非法词语。 这里我们使用DFA算法,它平均处理一个关键词的时间不到0.1秒。

5) 删除重复项

重复数据删除是非常重要的一步,但它需要相对较高的内存,这意味着要复制的文件大小不能超过可用内存大小。

目前的解决方案是使用sort + uniq。 首先使用split对目标文件进行分割,然后使用sort进行逐一排序,然后使用sort + uniq进行合并、去重。

![图片[17]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_16.jpg)

虽然没有显着减少内存使用量,但提高了计算效率。

bash shell 简短版本:

cat 输入文件名 | 排序| uniq > 输入文件名

bash shell大数据版本:

#!/bin/bash#命令行参数: #$1 输入文件 #$2 输出文件 basepath=$(cd `dirname $0`; pwd)echo `date` "[wordsUniq.sh DEBUG INFO] 开始文件分割…" split -l300000 $1 ${basepath}/words_split/split_ #文件分割 echo `date` "[wordsUniq.sh DEBUG INFO] 开始单一排序…" for f in `ls ${basepath}/words_split/`dosort ${ basepath}/words_split/${f} > ${basepath}/words_split/${f}.sort #单次排序 dideecho `date` "[wordsUniq.sh DEBUG INFO] 开始合并去重…"sort -sm $ {basepath}/words_split/*.sort|uniq > $2echo `date` "[wordsUniq.sh DEBUG INFO] 删除缓存数据…"rm ${basepath}/words_split/*

指示:

将其保存为filename.sh 文件,在当前目录中创建words_split 文件夹,然后使用以下命令行。 您可以指定输入和输出文件的路径。

sh 脚本名称.sh 输入文件 输出文件

OK,处理完成,现在我们得到了两个非常“干净”的初始词数据,分别是知乎百度PC端关键词和移动端关键词

5.2 词扩展

词扩展就是对获取到的父词进行扩展,因为一个页面可能会命中多个相关关键词

此外,我们可以假设,从第三方平台获取的单词只是他们能找到的、目前知乎点击的单词的子集。

我们应该尽量寻找其他词,以便更准确地估计有问题的页面的百度流量。

![图片[18]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_17.jpg)

假设有两个问题A和B,在你的词汇量中,A点击了50个关键词,总流量为1W,B点击了10个关键词,流量为100

那么你可能会忽略问题B而只处理问题A

然而B题居然打了100个关键词,流量10W。

这样,数据的不完整就造成了信息的空白,从而直接错失了获得这些流量的机会。

例如:

![图片[19]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_18.jpg)

扩容后,该页面共命中关键词47个,PC+移动端总流量132W。 广告过多,知乎被迫发出风控提醒。 下面是这部分数据的展示。

![图片[20]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_19.jpg)

这个怎么样? 您开始感受到数据的魅力了吗? 振作起来,让我们继续前进!

由于我们只做百度流量,所以下面就只用百度来拓展。

1)相关搜索+下拉框词抓取

很多人只知道这两个渠道,却不知道这两个渠道的本质:

相关搜索

相关搜索是横向扩展的,大部分是跨关键词主题的相关扩展。 可能存在严重的话题漂移。 为了保证相关性,只进行一轮爬取。

下拉框

下拉框垂直展开,大多数在关键字末尾添加词缀。

厘清通道本质的意义在于,关键词等文本数据只有两种扩展方向,其他通道扩展方式都是这两个基本方向的叠加或变体。

因为不同终端产生的数据可能不同,所以我们需要在同一个端口上分别扩展PC端和移动端的父字

即PC父词捕获PC相关搜索+PC下拉框,移动父词捕获移动相关搜索+下拉框

2)百度推广后的线路拓展

路径为:注册/登录>进入搜索推广>推广管理>关键词规划>关键词

注册免费,还可以使用爱奇SEM工具/斗牛SEO工具等。

![图片[21]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_20.jpg)

3)文字处理

首先,将每个通道中的单词合并到端口中。

bash外壳:

cat file1.txt file2.txt > all.txt

然后重复【5.1母词获取】的关键词清理和去重部分

5.3 获取关键词流量

同样使用百度推广后台的关键词规划器,但是使用“流量查询”的功能

这是百度官方给出的流量数据。 数据口径以前是日搜索量,现在变成了月搜索量,不过也没什么大不了的

有的朋友可能会有疑问,为什么不先抓取排名并过滤数据,以减轻下一步数据量的压力呢?

因为关键词规划师一次可以查询1000个! 10W个关键词只需要查询100次!

并且实际测试证明,获取cookie可以跨天使用,并且可以保持有效登录10+小时(答应我,请小心)

1)流量数据采集

通过模拟登录发布关键词数据

2)数据过滤

两端只保留搜索量>=N的关键词(值自定义)

您可以在获取数据的同时进行筛选,也可以将其分开并执行另一个筛选步骤。 我个人推荐后者。 如果指标不合理,还有重新筛选的空间。

bash外壳:

猫文件.txt | awk -F, '{$2>=100}' > file_new.txt

5.4 获取关键词排名

分别获取各端的排名数据,只保留

{问题 ID}

该url特征下,前10个关键词,并存储对应的问题url

5.5 可用流量

关键词流量不等于知乎提问页能获得的实际流量

前面提到,搜索流量到达页面之前还有一个点击步骤,所以我们应该计算可用流量,公式为:

可用流量=流量X点击率

点击率是根据排名来估算的,不过百度好像从来没有公布过点击率数据,咳咳……

但我们发现了Sistrix在2020年7月14日发布的一份谷歌点击率数据,该数据分析了超过8000万个关键词和数十亿条搜索结果。

虽然只是移动端的统计,但也没什么大不了的

原文(英文):

![图片[22]-【引流量增粉丝】知乎蓝海:2000W流量机会掘金指南-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230905/44d8bbb274eb53ea1ac3e07fd9a3d429_21.jpg)

每个关键词的可用流量计算完成后,我们的词库就建好了,Niceee!

6.知乎数据获取

数据获取的目的是我们可以从N维数据中初步判断某个问题的难度(对应9.1数据筛选)

数据比太多更精确,太多数据只会干扰判断

问题意见

![[创业资讯]网络赚钱的魅力-唐朝资源网](https://images.43s.cn/wp-content/uploads/20230915/3c588393a5e949eb0801dc63d10c06e6_0.png)

暂无评论内容